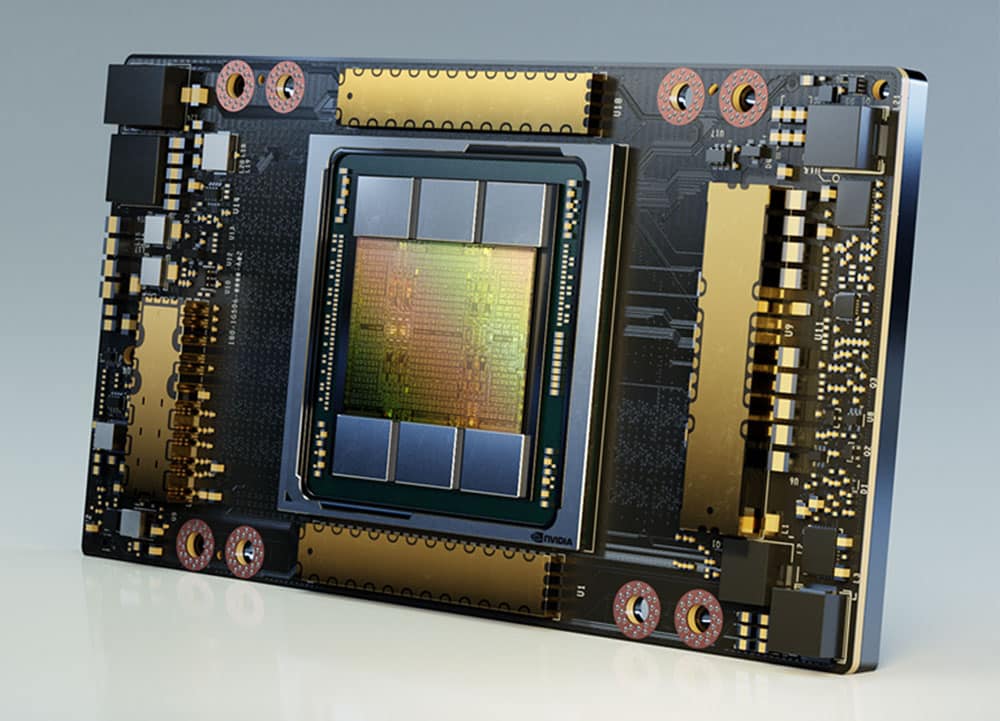

Hoy, en SC20, NVIDIA anunció que su popular GPU A100 duplicará la memoria de gran ancho de banda con la presentación de la GPU NVIDIA A100 de 80 GB. Esta nueva GPU será la innovación que impulsará la nueva plataforma de supercomputación NVIDIA HGX AI. Con el doble de memoria, la nueva GPU espera ayudar a los investigadores e ingenieros a alcanzar una velocidad y un rendimiento sin precedentes para desbloquear la próxima ola de IA y avances científicos.

Hoy, en SC20, NVIDIA anunció que su popular GPU A100 duplicará la memoria de gran ancho de banda con la presentación de la GPU NVIDIA A100 de 80 GB. Esta nueva GPU será la innovación que impulsará la nueva plataforma de supercomputación NVIDIA HGX AI. Con el doble de memoria, la nueva GPU espera ayudar a los investigadores e ingenieros a alcanzar una velocidad y un rendimiento sin precedentes para desbloquear la próxima ola de IA y avances científicos.

A principios de este año en GTC, NVICIA anunció el lanzamiento de su GPU de 7nm, la NVIDIA A100. Como escribimos en ese momento, el A100 se basa en la arquitectura Ampere de NVIDIA y contiene 54 mil millones de transistores. Al igual que las anteriores GPU de centros de datos de NVIDIA, la A100 incluye Tensor Cores. Los núcleos tensoriales son partes especializadas de la GPU diseñadas específicamente para realizar rápidamente un tipo de cálculo de suma y multiplicación de matriz que se usa comúnmente en la inferencia. Anteriormente, los Tensor Cores de NVIDIA solo podían admitir números de punto flotante de hasta treinta y dos bits. El A100 admite operaciones de coma flotante de sesenta y cuatro bits, lo que permite una precisión mucho mayor.

Se dice que aumentar la memoria de alto ancho de banda (HBM2e) a 80 GB puede ofrecer 2 terabytes por segundo de ancho de banda de memoria. Este nuevo impulso ayuda con las aplicaciones emergentes en HPC que tienen enormes requisitos de memoria de datos, como el entrenamiento de IA, el procesamiento de lenguaje natural y el análisis de big data, por nombrar algunos.

Características clave de A100 80GB

El A100 de 80 GB incluye muchas características innovadoras de la arquitectura NVIDIA Ampere:

- Núcleos tensoriales de tercera generación: proporciona hasta 20 veces el rendimiento de IA de la generación Volta anterior con un nuevo formato TF32, así como 2.5x FP64 para HPC, 20x INT8 para inferencia de IA y compatibilidad con el formato de datos BF16.

- Memoria de GPU HBM2e más grande y más rápida: Duplica la capacidad de memoria y es la primera en la industria en ofrecer más de 2 TB por segundo de ancho de banda de memoria.

- Tecnología MIG: duplica la memoria por instancia aislada, proporcionando hasta siete MIG de 10 GB cada uno.

- Dispersión estructural: ofrece modelos dispersos de inferencia de hasta 2x de aceleración.

- NVLink y NVSwitch de tercera generación: proporciona el doble de ancho de banda de GPU a GPU que la tecnología de interconexión de la generación anterior, acelerando las transferencias de datos a la GPU para cargas de trabajo intensivas de datos a 600 gigabytes por segundo.

Disponibilidad

Se espera que los proveedores de sistemas adicionales Atos, Dell Technologies, Fujitsu, GIGABYTE, Hewlett Packard Enterprise, Inspur, Lenovo, Quanta y Supermicro comiencen a ofrecer sistemas creados con placas base integradas HGX A100 con GPU A100 de 80 GB en la primera mitad del próximo año.

Interactuar con StorageReview

Boletín | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | Facebook | RSS Feed