Las aplicaciones de IA generativa crean respuestas de texto impresionantes que a veces son precisas y otras veces completamente fuera de tema. Estas aplicaciones inteligentes funcionan con modelos de lenguaje grande (LLM) capaces de responder consultas complejas y crear obras de arte, literatura y más. Es fundamental garantizar que estas aplicaciones inteligentes generen respuestas de texto que sean precisas, apropiadas, sobre el tema, seguras y actuales.

Las aplicaciones de IA generativa crean respuestas de texto impresionantes que a veces son precisas y otras veces completamente fuera de tema. Estas aplicaciones inteligentes funcionan con modelos de lenguaje grande (LLM) capaces de responder consultas complejas y crear obras de arte, literatura y más. Es fundamental garantizar que estas aplicaciones inteligentes generen respuestas de texto que sean precisas, apropiadas, sobre el tema, seguras y actuales.

NVIDIA ha lanzado un software de código abierto para ayudar a los desarrolladores a mantener esas aplicaciones de IA generativa en el buen camino. NeMo Guardrails ayudará a garantizar que las aplicaciones de IA respondan de manera adecuada, precisa y segura. El software NeMo Guardrails incluye todo el código, los ejemplos y la documentación que las empresas necesitan para sentirse seguras al implementar aplicaciones de inteligencia artificial que generan texto.

Implicaciones empresariales

Las empresas han mostrado dudas a la hora de implementar modelos de lenguaje extenso (LLM) debido a preocupaciones en torno a la seguridad y la posibilidad de que los LLM generen contenido inapropiado o sesgado. La introducción de NeMo Guardrails ofrece una solución prometedora para estos desafíos, ayudando a mitigar los riesgos asociados con la adopción de LLM y ayudando a las empresas a superar sus dudas. Al proporcionar un conjunto de herramientas para construir sistemas conversacionales LLM seguros y confiables, NeMo Guardrails permite a los desarrolladores establecer fácilmente reglas programables que dictan las interacciones de los usuarios, asegurando que las aplicaciones basadas en LLM cumplan con los estándares y políticas empresariales.

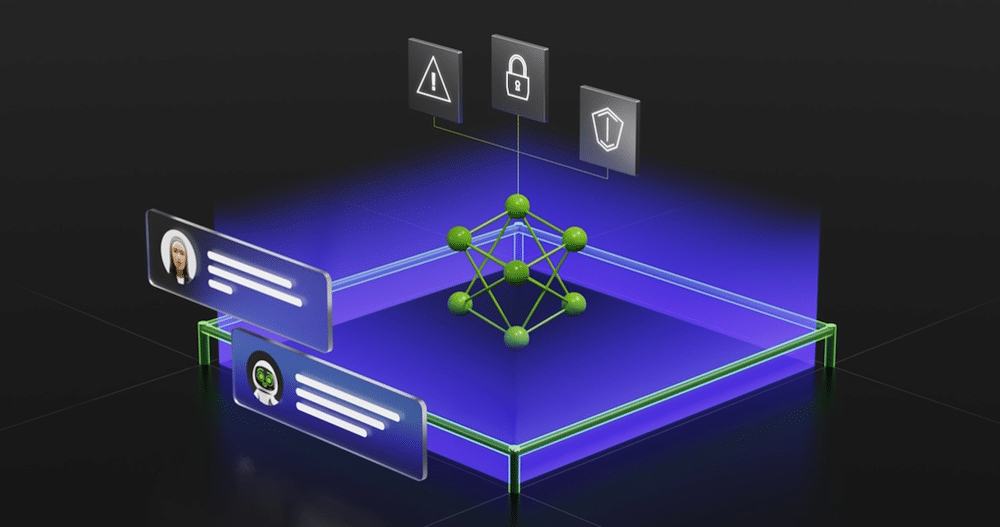

Las barandillas temáticas, de seguridad y protección compatibles con NeMo Guardrails abordan algunas de las principales preocupaciones que hemos escuchado de las empresas, desde mantener el enfoque temático hasta prevenir la desinformación o las respuestas inapropiadas o maliciosas. Al ofrecer un modelo de seguridad robusto y mitigar los riesgos asociados con las aplicaciones basadas en LLM, NeMo Guardrails infunde mayor confianza en las empresas para adoptar esta poderosa tecnología.

Con el lanzamiento de NeMo Guardrails, es de esperar que pueda servir como catalizador para una adopción empresarial más amplia de LLM, cerrando la brecha entre las capacidades de la tecnología de IA y los requisitos de seguridad y protección del mundo empresarial.

Seguro, sobre el tema, seguro

Muchas industrias están adoptando LLM a medida que implementan aplicaciones de IA que, en última instancia, responderán las preguntas de los clientes, proporcionarán resúmenes de documentos extensos, escribirán software y acelerarán el diseño de medicamentos. Con esta audiencia diversa, la seguridad en la IA generativa es una preocupación importante, y NVIDIA NeMo Guardrails se diseñó para funcionar con todos los LLM, incluido ChatGPT de OpenAI, para ayudar a mantener a los usuarios seguros.

Los desarrolladores pueden usar NeMo Guardrails para configurar tres tipos de límites:

- Barandillas tópicas: Evita que las aplicaciones se desvíen de su curso hacia un área no deseada, como evitar que los asistentes de servicio al cliente respondan preguntas sobre el clima.

- Barandillas de seguridad: Garantiza que las aplicaciones respondan con información precisa y adecuada, filtrando el lenguaje no deseado y haciendo cumplir las referencias solo a fuentes creíbles.

- barandillas de seguridad: restringe las aplicaciones a hacer conexiones solo con aplicaciones externas de terceros que se sabe que son seguras.

NeMo Guardrails no requiere que los desarrolladores de software sean expertos en aprendizaje automático o se conviertan en científicos de datos. Se pueden crear nuevas reglas rápidamente con solo unas pocas líneas de código.

Código abierto y disponible en GitHub

NVIDIA está agregando NeMo Guardrails al marco de NVIDIA NeMo, proporcionando todo lo que los usuarios necesitan para entrenar y ajustar los modelos de lenguaje. Gran parte del marco NeMo ya está disponible en GitHub, y las empresas pueden obtener un paquete completo y compatible, ya que es parte de la plataforma de software NVIDIA AI Enterprise.

NeMo también forma parte de NVIDIA AI Foundations, una familia de servicios en la nube para empresas que buscan crear y ejecutar modelos de IA generativos personalizados basados en sus propios conjuntos de datos y conocimiento del dominio.

Construido sobre Colang

NeMo Guardrails se basa en CoLang, un lenguaje de modelado y un tiempo de ejecución asociado para la IA conversacional. Colang proporciona una interfaz legible y extensible para que los usuarios definan o controlen el comportamiento de los bots conversacionales con lenguaje natural.

Las medidas de seguridad se crean mediante la definición de flujos en un archivo Colang mediante formularios, mensajes y flujos canónicos. Esto se logra utilizando un lenguaje natural, lo que facilita la construcción y el mantenimiento del bot en la tarea. Varios Ejemplos de GitHub abordar patrones comunes para implementar barandillas.

Interactuar con StorageReview

Boletín | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | TikTok | RSS Feed