Open Compute Project (OCP) ha annunciato l'aggiunta del server edge Wiwynn ES200 e della baseboard GPU NVIDIA HGX-H100 alla propria piattaforma.

Open Compute Project (OCP) ha annunciato l'aggiunta del server edge Wiwynn ES200 e della baseboard GPU NVIDIA HGX-H100 alla propria piattaforma.

Il server edge a breve profondità di Wiwynn è progettato per soddisfare la crescente domanda di potenza di calcolo nei siti edge, in particolare per applicazioni come l’inferenza AI istantanea, l’analisi dei dati in loco e l’elaborazione video multicanale.

Si prevede che le specifiche fisiche della scheda base GPU HGX-H100 di NVIDIA contribuiranno a migliorare la capacità del sottoprogetto OAI di OCP di sfruttare HGX e di sviluppare specifiche di piattaforma e sistema scalabili, convenienti, ad alta efficienza per il calcolo ad alte prestazioni in applicazioni AI e HPC.

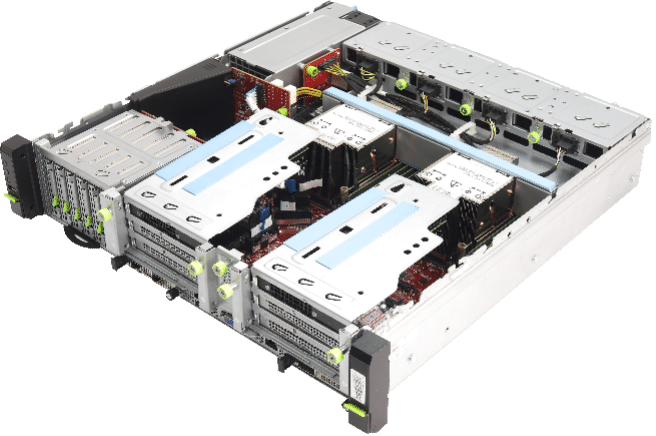

Server perimetrale Wiwynn ES200

Wiwynn ES200 è un server edge dual-socket 2U alimentato da un processore scalabile Intel Xeon di terza generazione. Con il bilanciamento NUMA, è in grado di fornire la potenza di calcolo di ciascun processore installato per soddisfare separatamente carichi di lavoro diversi senza creare colli di bottiglia nella comunicazione tra le CPU.

Dispone inoltre di slot PCIe Gen4 x16 aggiuntivi, che possono essere dotati di due schede aggiuntive a doppia larghezza. Ciò aggiunge molta flessibilità al sistema, rendendolo ideale per casi d'uso come l'accelerazione dell'inferenza dell'intelligenza artificiale, la transcodifica video e l'analisi dei dati, nonché casi d'uso che richiedono connettività di rete aggiuntiva. È dotato di moduli di archiviazione flessibili tra cui EDSFF (E1.S) o U.2 SSD e due schede OCP NIC 3.0, che consentono all'ES200 di produrre un'impressionante elaborazione dei dati locali e una connessione di rete a larghezza di banda elevata.

L'ES200 è anche conforme a NEBS-3 e presenta un fattore di forma compatto a profondità ridotta. Inoltre, Wiwynn indica che può funzionare senza problemi in condizioni operative difficili e può adattarsi a vari siti marginali.

Specifiche del nodo Wiwynn ES200 Edge Server

| Specifica del nodo | |

| Processore | Processori scalabili Intel Xeon di terza generazione, TDP 3 W/250 W |

| Socket del processore | 2 |

| chipset | Serie Intel C621A |

| Sicurezza | TPM v2.0 (opzione) |

| Bus di sistema | Interconnessione Intel UltraPath; 11.2 GT/s |

| Memorie | 16 slot DIMM; DDR4 fino a 3200 MT/s e fino a 64 GB per DIMM; 12 slot DIMM con un massimo di 2 DCPMM (Intel Barlow Pass) |

| Archiviazione | ‧ Uno slot per modulo SSD 2280/22110 M.2 integrato ‧ Sei U.2 (15/7 mm) o otto EDSFF E1.S (5.9/9.5 mm) |

| Slot di espansione | Fino a sei slot PCIe Gen4: ‧ Due PCIe x16 FHFL a doppia larghezza + un PCIe x8 FHHL ‧ Uno slot PCIe x16 FHHL + Due PCIe x8 FHHL ‧ Sei slot PCIe x8 FHHL sono opzionali su richiesta Due schede di rete OCP 3.0 x16 integrate |

| LAN di gestione | ‧ Una porta BMC dedicata GbE |

| Porte I / O | ‧ Pulsante di accensione con LED ‧ Pulsante UID con LED ‧ Tasto RST ‧ Tre porte USB ‧ Porta di gestione BMC (lato anteriore) ‧ Porta VGA (D-sub) |

| Specifiche del telaio | |

| Dimensioni | scaffale 2U; 86(A) x 440 (L) x 450 (P) (mm) |

| PSU | CRPS da 1 W hot plug ridondante (1+1600). |

| Fan | Quattro rotori doppi 8038, ridondanti (7+1) |

| Peso | 14.47 kg |

| Ambiente | ‧ Intervallo di temperatura operativa ambientale: da -5 a +55 gradi Celsius

‧ Umidità relativa di funzionamento e conservazione: dal 10% al 90% (senza condensa) ‧ Intervallo di temperatura di conservazione: da -40 a +70 gradi Celsius |

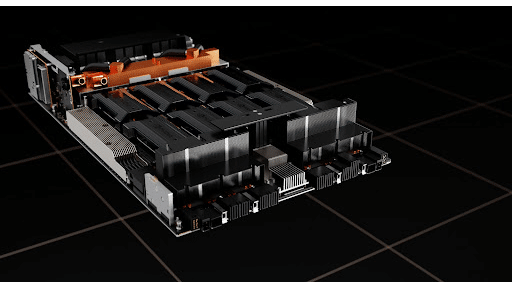

NVIDIA Battiscopa HGX-H100

NVIDIA HGX-H100 è un baseboard che ospita otto dei più recenti Moduli GPU Hopper. La specifica fisica della scheda base HGX definisce elementi come le interfacce host della dimensione fisica, le interfacce di gestione e di debug. Il pacchetto di contributi di NVIDIA comprende anche le specifiche fisiche della baseboard, l'elenco dei pin di input/output della baseboard e una mappa dei pin, nonché un disegno 2D/3D.

Il seguente elenco di OCP indica come il contributo di NVIDIA HGX si basa sui suoi "quattro principi": efficienza, scalabilità, apertura e impatto:

- Efficienza: questo è il fattore di forma della scheda base HGX di terza generazione e ogni generazione ha fornito un throughput di addestramento AI circa 3 volte-3 volte superiore consumando una potenza attiva simile. Di conseguenza, la baseboard HGX è ora lo standard de facto, con la maggior parte degli hyperscaler globali che progettano attorno a questo fattore di forma per l’addestramento e l’inferenza dell’IA.

- Scalabilità – A livello globale, centinaia di migliaia di sistemi HGX sono in produzione. I sistemi e gli involucri per questo fattore di forma saranno stabili e costruiti su larga scala. La specifica HGX includerà dimensioni fisiche, interfacce di gestione per il monitoraggio/debug ecc. per servizi su larga scala.

- Apertura: i sistemi basati su HGX sono la piattaforma di formazione AI più comune a livello globale. Molti OEM/ODM hanno creato sistemi di intelligenza artificiale basati su HGX. Con il contributo di questa specifica fisica HGX, il gruppo OAI convergerà il più possibile UBB2.0 con la specifica HGX. Gli OEM/ODM potrebbero sfruttare lo stesso progetto di sistema con acceleratori diversi su schede base di tipo UBB/HGX, ad esempio la stessa dimensione della scheda base, interfacce host, interfacce di gestione, erogazione di potenza, ecc.

- Impatto – Le piattaforme NVIDIA HGX sono diventate di fatto lo standard globale per le piattaforme di formazione AI. L'apertura di questo fattore di forma della scheda base HGX consente ad altri fornitori di acceleratori IA di sfruttare l'ecosistema di sistemi e alloggiamenti HGX. Ciò dovrebbe spingere altri fornitori di intelligenza artificiale a sfruttare l’infrastruttura esistente e ad adottare prima le loro soluzioni. Ciò accelera ulteriormente l’innovazione nei campi AI/HPC.

Interagisci con StorageReview

Newsletter | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | Facebook | TikTok | RSS feed