VMware Explore 2023 이벤트에서 VMware는 기업 내 생성 AI 채택을 촉진하고 신뢰할 수 있는 데이터의 잠재력을 활용하는 것을 목표로 하는 새로운 프라이빗 AI 제품을 공개했습니다. 아키텍처 접근 방식이 특징인 VMware Private AI는 AI의 이점과 조직의 실질적인 개인 정보 보호 및 규정 준수 요구 사항 간의 균형을 유지합니다.

VMware Explore 2023 이벤트에서 VMware는 기업 내 생성 AI 채택을 촉진하고 신뢰할 수 있는 데이터의 잠재력을 활용하는 것을 목표로 하는 새로운 프라이빗 AI 제품을 공개했습니다. 아키텍처 접근 방식이 특징인 VMware Private AI는 AI의 이점과 조직의 실질적인 개인 정보 보호 및 규정 준수 요구 사항 간의 균형을 유지합니다.

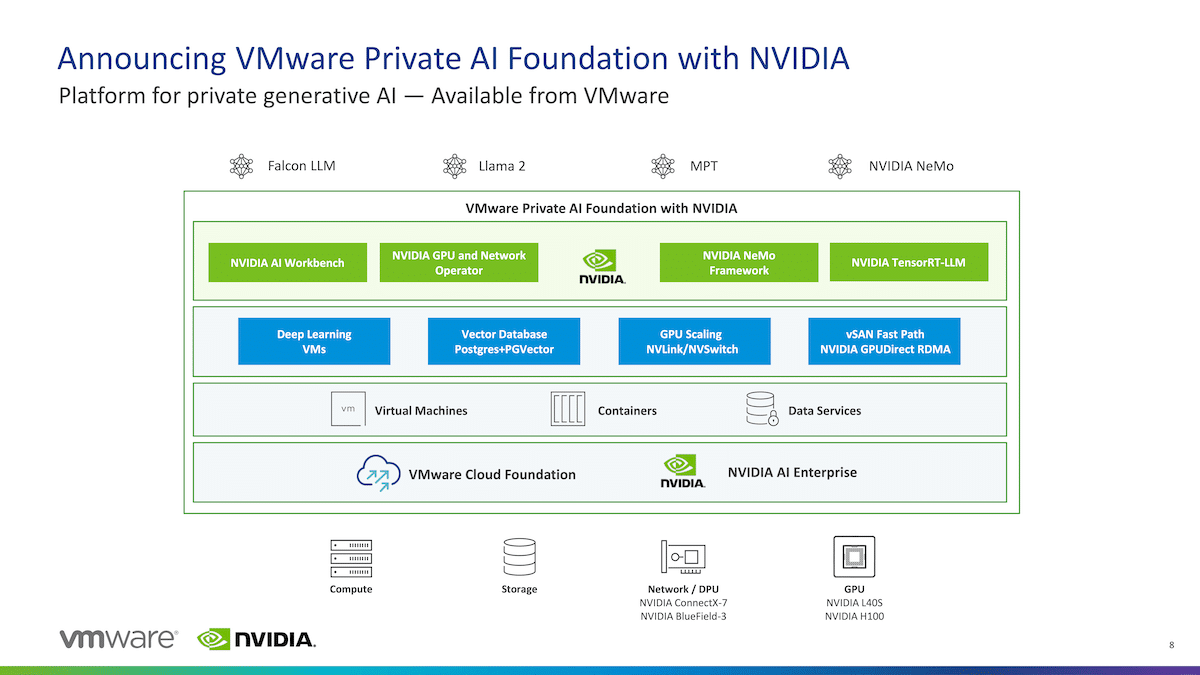

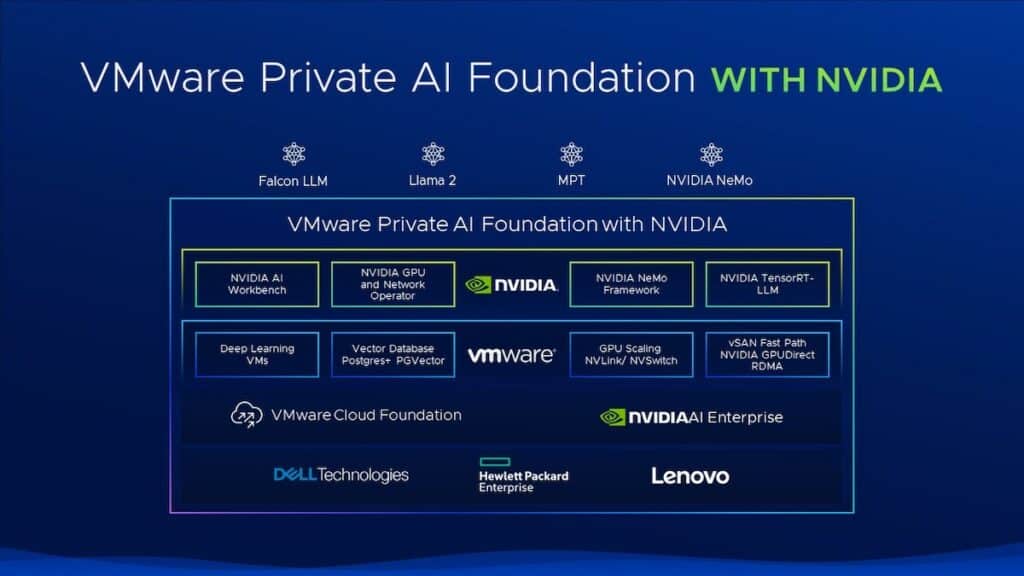

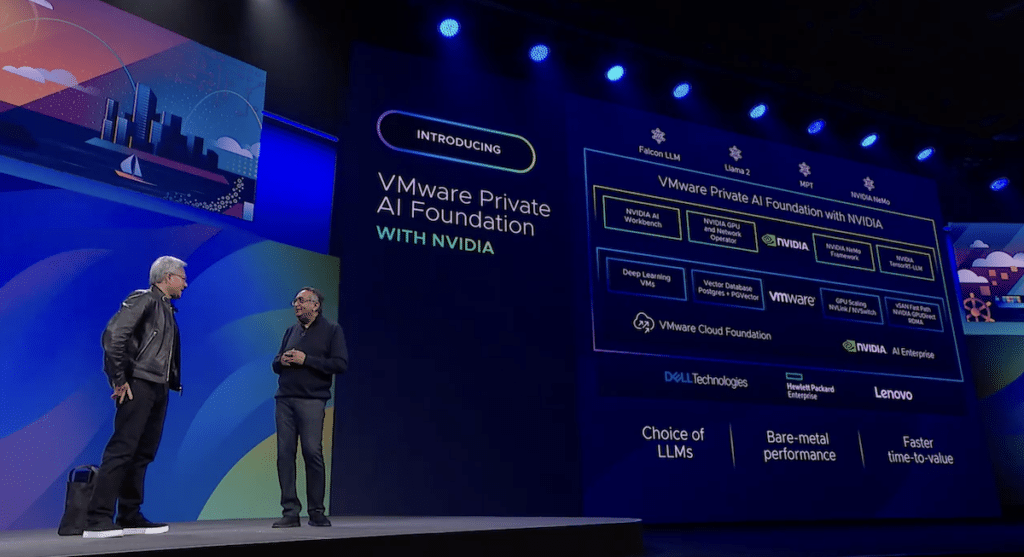

NVIDIA와 함께하는 VMware Private AI Foundation을 통해 기업은 모델을 맞춤화하고 지능형 챗봇, 보조자, 검색 및 요약을 포함한 생성적 AI 애플리케이션을 실행할 수 있습니다. 플랫폼은 다음 기능을 갖춘 완전히 통합된 솔루션이 될 것입니다. NVIDIA의 생성 AI 소프트웨어 및 가속 컴퓨팅, 기반 VMware 클라우드 재단 AI에 최적화되어 있습니다.

전략적 파트너십을 기반으로 NVIDIA와 함께하는 VMware Private AI Foundation은 생성 AI 시대에 점점 커지는 관심을 수용할 수 있는 도구와 함께 VMware의 클라우드 인프라에 배포할 수 있는 도구를 기업에 제공합니다. 이 확장은 VMware의 프라이빗 AI 아키텍처를 NVIDIA AI Enterprise 소프트웨어 및 가속 컴퓨팅과 통합하여 데이터 센터, 퍼블릭 클라우드 및 엣지 전반에 걸쳐 생성적 AI 애플리케이션을 배포하기 위한 턴키 솔루션을 제공합니다.

비즈니스 이점을 더 빠르게 달성하기 위해 기업은 생성 AI 애플리케이션의 개발, 테스트 및 배포를 간소화하려고 합니다. NVIDIA가 포함된 VMware Private AI Foundation을 통해 기업은 이 기능을 활용하여 대규모 언어 모델을 사용자 지정하고, 내부 사용을 위한 보다 안전한 비공개 모델을 생성하고, 사용자에게 서비스로서의 생성 AI를 제공하고, 대규모 추론 워크로드를 안전하게 실행할 수 있습니다.

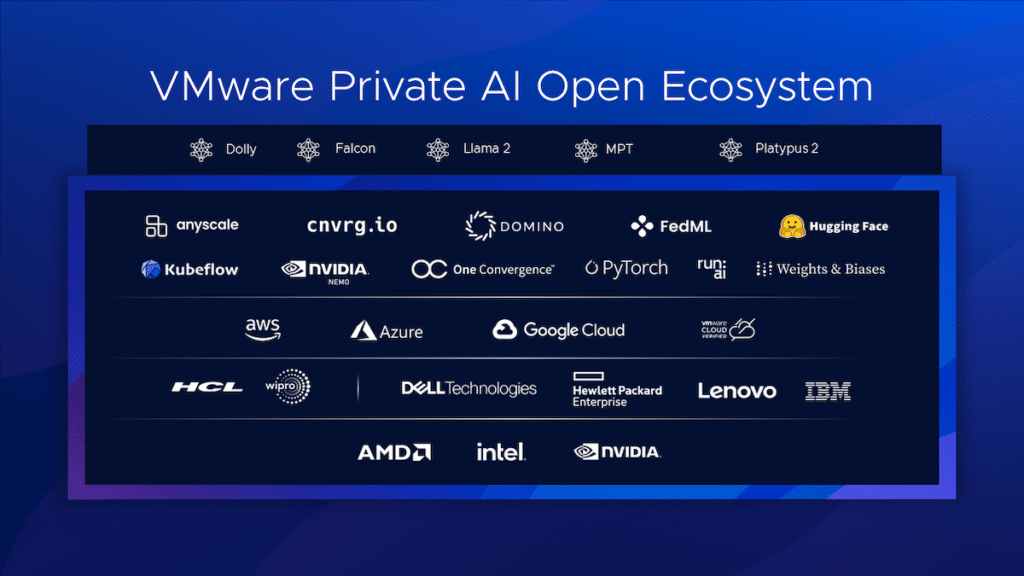

이 플랫폼에는 기업이 개인 데이터에 대해 훈련된 입증된 모델을 비용 효율적으로 실행할 수 있도록 지원하는 통합 AI 도구가 포함될 것으로 예상됩니다. 고객은 현재와 미래의 요구 사항에 맞춰 최고 수준의 오픈 소스 소프트웨어 기술을 활용하는 오픈 소스용 VMware Private AI 참조 아키텍처를 통해 원하는 AI 결과를 얻을 수 있습니다.

이 플랫폼은 VMware Cloud Foundation 및 NVIDIA AI Enterprise 소프트웨어를 기반으로 구축되어 다양한 이점을 제공할 것으로 예상됩니다. 개인 정보 보호 관점에서 고객은 안전한 액세스로 데이터 개인 정보를 보호하는 아키텍처를 통해 데이터가 있는 위치에 인접한 AI 서비스를 실행할 수 있습니다.

기업은 NVIDIA NeMo에서 Llama 2에 이르기까지 모델을 구축하고 실행할 위치를 다양하게 선택할 수 있습니다. 여기에는 OEM 하드웨어 구성과 향후 공용 클라우드 및 서비스 제공업체 제품이 포함됩니다.

NVIDIA 가속 인프라에서 실행되는 플랫폼의 경우 예상 성능은 베어메탈과 같거나 그 이상이어야 합니다. 가상화된 환경의 GPU 확장 최적화를 통해 AI 워크로드를 단일 VM 및 여러 노드에서 최대 16개의 vGOU/GPU로 확장하여 생성 AI 모델 미세 조정 및 배포 속도를 높일 수 있습니다.

GPU, DPU 및 CPU 전반에 걸쳐 모든 컴퓨팅 리소스의 사용을 최대화한다는 것은 팀 간에 공유되는 풀링된 리소스 환경을 구축하는 동시에 전체 비용이 낮아질 것으로 예상된다는 것을 의미합니다. VMware vSAN Express Storage Architecture(ESA)는 성능 최적화된 NVMe 스토리지를 제공하여 CPU를 사용하지 않고도 스토리지에서 GPU로 직접 I/O 전송을 제공하는 RDMA를 통한 GPUDirect 스토리지를 지원합니다.

vSphere와 NVIDIA NVSwitch 간의 긴밀한 통합을 통해 다중 GPU 모델을 GPU 간 병목 현상 없이 실행하여 가속화된 네트워킹을 제공할 수 있습니다.

배포하고 가치 창출 시간을 실현하는 데 너무 오랜 시간이 걸린다면 이러한 모든 이점은 거의 의미가 없습니다. vSphere Deep Learning VM 이미지 및 이미지 저장소를 사용하는 신속한 프로토타이핑 기능은 사전 설치된 프레임워크와 성능 최적화 라이브러리를 포함하는 안정적인 턴키 솔루션 이미지를 제공합니다.

엔드투엔드 클라우드 네이티브 프레임워크이자 NVIDIA AI Enterprise에 포함된 NVIDIA AI 플랫폼용 OS인 NVIDIA NeMo는 플랫폼 기능입니다. NeMo를 사용하면 기업은 사용자 정의 프레임워크, 가드레일 툴킷, 데이터 큐레이션 도구 및 사전 훈련된 모델을 결합하여 생성적 AI 모델을 거의 어디에서나 구축, 사용자 정의 및 배포할 수 있습니다.

생성 AI를 프로덕션에 배포하는 NeMo는 TRT-LLM(대형 언어 모델용 TensorRT)을 사용하여 NVIDIA GPU의 최신 LLM에서 추론 성능을 가속화하고 최적화합니다. NeMo를 통해 NVIDIA와 함께하는 VMware Private AI Foundation을 통해 기업은 데이터를 가져와 VMware의 하이브리드 클라우드 인프라에서 맞춤형 생성 AI 모델을 구축하고 실행할 수 있습니다.

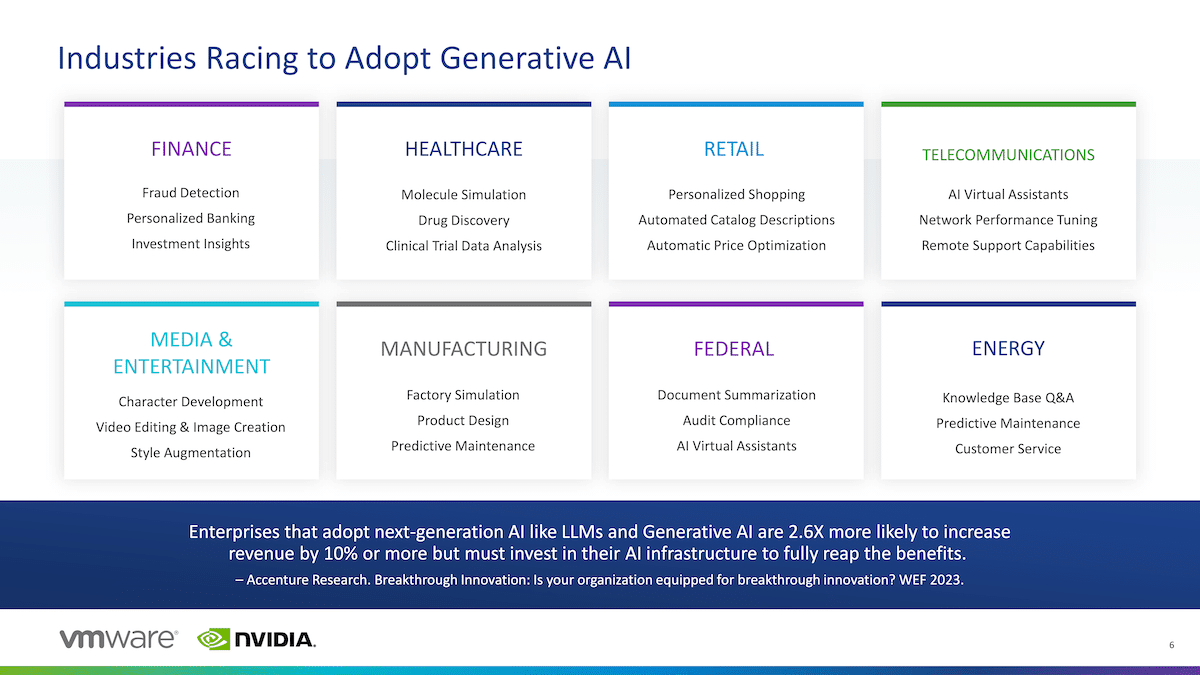

VMware Private AI Foundation은 퍼블릭 클라우드, 엔터프라이즈 데이터 센터 또는 엣지에 상관없이 엔터프라이즈 데이터가 생성, 처리 및 소비되는 위치로 AI 기능과 모델을 확장합니다. 이러한 새로운 제품을 출시함으로써 VMware는 고객이 유연성과 제어를 통합하여 차세대 AI 기반 애플리케이션을 추진할 수 있도록 지원하는 것을 목표로 합니다. 이 애플리케이션은 직원 생산성을 크게 향상시키고 주요 비즈니스 기능 전반에 걸쳐 변화를 촉발하며 상당한 경제적 영향을 미칠 수 있는 잠재력을 갖고 있습니다. McKinsey 보고서에서는 생성 AI가 세계 경제에 연간 최대 4.4조 XNUMX천억 달러를 기여할 것으로 예상합니다.

이러한 진화의 성공에 중요한 것은 프라이빗하면서도 널리 분산된 데이터 활용을 위한 길을 열어주는 멀티 클라우드 환경의 구축입니다. VMware의 멀티 클라우드 전략은 기업이 개인 데이터를 사용하여 AI 모델을 구축, 사용자 정의 및 배포하는 데 더 큰 유연성을 제공하는 동시에 다양한 환경에서 보안과 탄력성을 보장합니다.

VMware의 CEO인 Raghu Raghuram은 생성 AI의 실행 가능성은 데이터 개인정보 보호를 유지하고 IP 위험을 최소화하는 데 달려 있다고 강조합니다. VMware Private AI는 이러한 문제를 해결하여 조직이 신뢰할 수 있는 데이터를 활용하여 멀티 클라우드 환경 내에서 효율적인 AI 모델 구축 및 실행을 수행할 수 있도록 지원합니다.

StorageReview에 참여

뉴스레터 | 유튜브 | 팟캐스트 iTunes/스포티 파이 | 인스타그램 | 트위터 | 틱톡 서비스 | RSS 피드