Os aplicativos generativos de IA criam respostas de texto impressionantes que às vezes são precisas e outras vezes completamente fora do tópico. Esses aplicativos inteligentes são alimentados por modelos de linguagem grandes (LLMs) capazes de responder a consultas complexas e criar obras de arte, literatura e muito mais. É fundamental garantir que esses aplicativos inteligentes gerem respostas de texto precisas, apropriadas, no tópico, seguras e atuais.

Os aplicativos generativos de IA criam respostas de texto impressionantes que às vezes são precisas e outras vezes completamente fora do tópico. Esses aplicativos inteligentes são alimentados por modelos de linguagem grandes (LLMs) capazes de responder a consultas complexas e criar obras de arte, literatura e muito mais. É fundamental garantir que esses aplicativos inteligentes gerem respostas de texto precisas, apropriadas, no tópico, seguras e atuais.

A NVIDIA lançou um software de código aberto para ajudar os desenvolvedores a manter esses aplicativos generativos de IA no caminho certo. O NeMo Guardrails ajudará a garantir que os aplicativos de IA respondam de maneira adequada, precisa e segura. O software NeMo Guardrails inclui todo o código, exemplos e documentação que as empresas precisam para se sentirem confiantes com a implantação de aplicativos de IA que geram texto.

Implicações Corporativas

As empresas demonstraram hesitação em implementar modelos de linguagem grandes (LLMs) devido a preocupações relacionadas à segurança e ao potencial de LLMs gerarem conteúdo impróprio ou tendencioso. A introdução do NeMo Guardrails oferece uma solução promissora para esses desafios, ajudando a mitigar os riscos associados à adoção do LLM e ajudando as empresas a superar suas hesitações. Ao fornecer um kit de ferramentas para criar sistemas de conversação LLM seguros e confiáveis, o NeMo Guardrails permite que os desenvolvedores estabeleçam facilmente regras programáveis que ditam as interações do usuário, garantindo que os aplicativos baseados em LLM obedeçam aos padrões e políticas empresariais.

As proteções tópicas, de segurança e proteção suportadas pelo NeMo Guardrails abordam algumas das principais preocupações que ouvimos das empresas, desde a manutenção do foco tópico até a prevenção de desinformação ou respostas inadequadas ou maliciosas. Ao oferecer um modelo de segurança robusto e reduzir os riscos associados aos aplicativos baseados em LLM, o NeMo Guardrails instila maior confiança nas empresas para adotar essa poderosa tecnologia.

Com o lançamento do NeMo Guardrails, esperamos que ele possa servir como um catalisador para a adoção mais ampla de LLMs pelas empresas, preenchendo a lacuna entre os recursos da tecnologia de IA e os requisitos de segurança e proteção do mundo dos negócios.

Seguro, no tópico, seguro

Muitos setores estão adotando LLMs à medida que implementam aplicativos de IA que, em última análise, responderão às perguntas dos clientes, fornecerão resumos para documentos extensos, escreverão software e acelerarão o design de medicamentos. Com esse público diversificado, a segurança na IA generativa é uma preocupação significativa, e o NVIDIA NeMo Guardrails foi projetado para funcionar com todos os LLMs, incluindo o ChatGPT da OpenAI, para ajudar a manter os usuários seguros.

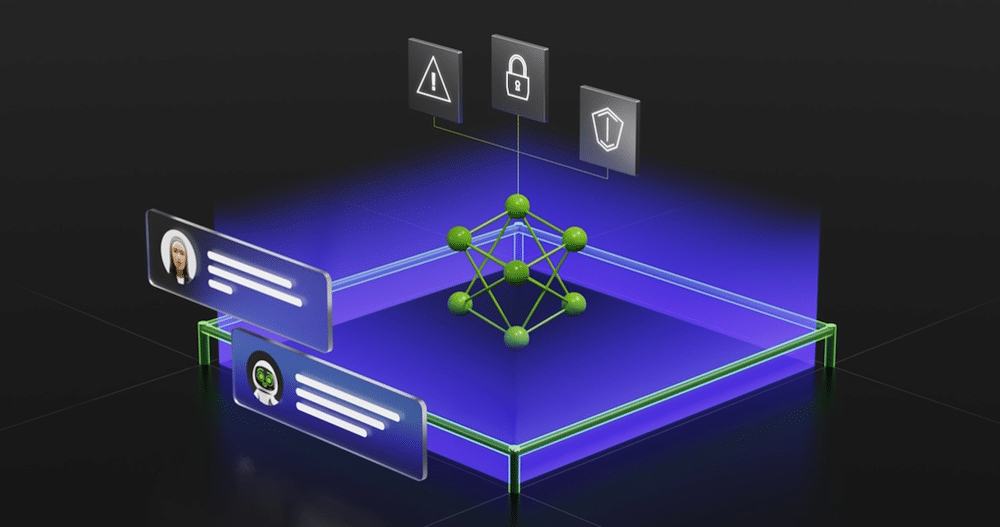

Os desenvolvedores podem usar o NeMo Guardrails para configurar três tipos de limites:

- Guarda-corpos tópicos: Evita que os aplicativos se desviem do curso para alguma área indesejada, como impedir que os assistentes de atendimento ao cliente respondam a perguntas sobre o clima.

- Guarda-corpos de segurança: Garante que os aplicativos respondam com informações precisas e apropriadas, filtrando linguagem indesejada e fazendo com que as referências sejam feitas apenas a fontes confiáveis.

- Grades de segurança: restringe os aplicativos a fazerem conexões apenas com aplicativos externos de terceiros conhecidos como seguros.

O NeMo Guardrails não exige que os desenvolvedores de software sejam especialistas em aprendizado de máquina ou cientistas de dados. Novas regras podem ser criadas rapidamente com apenas algumas linhas de código.

Código aberto e disponível no GitHub

A NVIDIA está adicionando o NeMo Guardrails à estrutura do NVIDIA NeMo, fornecendo tudo o que os usuários precisam para treinar e ajustar os modelos de linguagem. Grande parte da estrutura NeMo já está disponível no GitHub, e as empresas podem obter um pacote completo e compatível, pois faz parte da plataforma de software NVIDIA AI Enterprise.

O NeMo também faz parte do NVIDIA AI Foundations, uma família de serviços em nuvem para empresas que buscam criar e executar modelos personalizados de IA generativa com base em seus próprios conjuntos de dados e conhecimento de domínio.

Construído em Colang

O NeMo Guardrails é construído em CoLang, uma linguagem de modelagem e tempo de execução associado para IA conversacional. Colang fornece uma interface legível e extensível para os usuários definirem ou controlarem o comportamento de bots de conversação com linguagem natural.

As proteções são criadas definindo fluxos em um arquivo Colang usando formulários, mensagens e fluxos canônicos. Isso é obtido usando linguagem natural, simplificando a construção e a manutenção do bot na tarefa. Diversos Exemplos do GitHub abordar padrões comuns para a implementação de guardrails.

Explore as grades de proteção do NeMo

Envolva-se com a StorageReview

Newsletter | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | TikTok | RSS feed