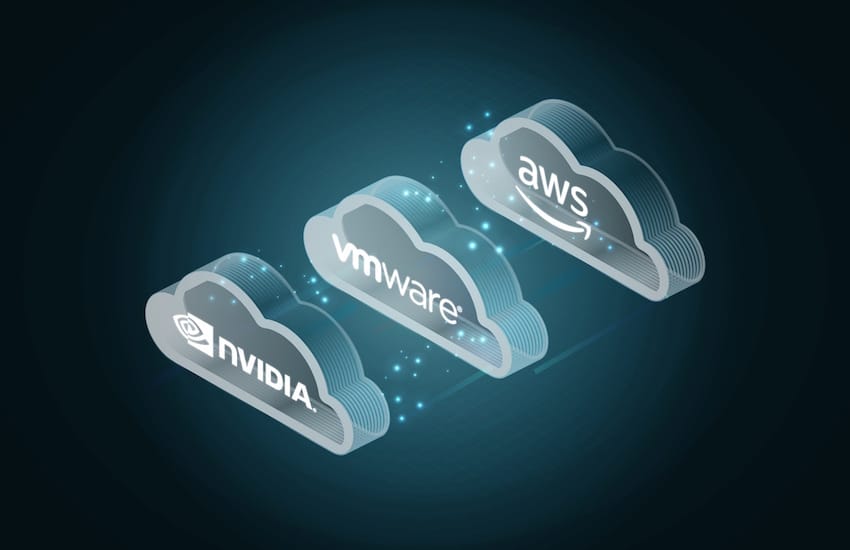

今天在舊金山舉行的 VMworld 2019 上,NVIDIA 和 VMware 宣布他們將為 AWS 上的 VMware Cloud 提供加速 GPU 服務。 這種新的技術組合將允許 VMware Cloud on AWS 以高度可擴展和安全的方式為其現代企業應用程序提供支持,包括人工智能、機器學習和數據分析工作流。

AI 可以從字面上改變企業應用程序。 許多組織,無論大小,都在採用 AI 和 AI 策略來創建預測模型。 與此同時,正在部署機器學習應用程序,例如圖像和語音識別、高級金融建模和使用神經網絡的自然語言處理。 AI 和 ML 應用程序都嚴重依賴 NVIDIA GPU 來實現更快的訓練和實時推理。

AWS 上的 VMware Cloud 客戶也希望利用 AI 和 ML,現在通過這種合作關係,他們將能夠訪問高度可擴展且安全的雲服務,該服務包含由 NVIDIA T2 GPU 和新的 NVIDIA 虛擬計算加速的 Amazon EC4 裸機實例服務器 (vComputeServer) 軟件。 使用基於 VMware vSphere 的應用程序的客戶將能夠將它們以及容器無縫遷移到 VMware Cloud on AWS。 這些應用程序不僅可以原封不動地遷移,還可以享受雲的所有優勢,包括高性能計算、機器學習、數據分析和視頻處理應用程序。

帶有 NVIDIA GPU 的 VMware Cloud on AWS 在人工智能、機器學習和數據分析方面的優勢包括:

- 無縫可移植性:客戶將能夠通過單擊按鈕移動由 NVIDIA vComputeServer 軟件和 GPU 提供支持的工作負載,而無需使用 VMware HCX 停機。 這將為客戶提供更多選擇和靈活性,以在雲端或本地執行訓練和推理。

- 彈性 AWS 基礎設施:由於能夠自動擴展由 NVIDIA T4 加速的 VMware Cloud on AWS 集群,管理員將能夠根據數據科學家的需求擴大或縮小可用的培訓環境。

- 現代應用程序的加速計算:NVIDIA T4 GPU 具有 Tensor Core,可加速深度學習推理工作流程。 當這些與用於 GPU 虛擬化的 vComputeServer 軟件相結合時,企業可以靈活地在虛擬化環境中運行 GPU 加速的工作負載,如人工智能、機器學習和數據分析,以提高安全性、利用率和可管理性。

- 一致的混合雲基礎架構和運營:借助 VMware Cloud on AWS,組織可以跨混合雲建立一致的基礎架構和一致的運營,利用 VMware 行業標準 vSphere、vSAN 和 NSX 作為實現關鍵業務應用程序現代化的基礎。 IT 操作員將能夠管理 vCenter 中的 GPU 加速工作負載,以及在本地 vSphere 上運行的 GPU 加速工作負載。

- 無縫的端到端數據科學和分析管道:NVIDIA T4 數據中心 GPU 為主流服務器增壓並使用 NVIDIA RAPIDS 加速數據科學技術,NVIDIA RAPIDS 是一組用於數據科學的 NVIDIA GPU 加速庫,包括深度學習、機器學習和數據分析.