Durante l'evento VMware Explore del 2023, VMware ha annunciato VMware Private AI e VMware Private AI Foundation in collaborazione con NVIDIA. All'NVIDIA GTC di questa settimana, VMware ha fatto un ulteriore passo avanti annunciando la disponibilità iniziale di VMware Private AI Foundation con NVIDIA.

Durante l'evento VMware Explore del 2023, VMware ha annunciato VMware Private AI e VMware Private AI Foundation in collaborazione con NVIDIA. All'NVIDIA GTC di questa settimana, VMware ha fatto un ulteriore passo avanti annunciando la disponibilità iniziale di VMware Private AI Foundation con NVIDIA. Questa collaborazione ha portato allo sviluppo di una piattaforma basata su VMware Cloud Foundation che incorpora i microservizi di inferenza AI di NVIDIA. La piattaforma include anche contributi di aziende come Hugging Face.

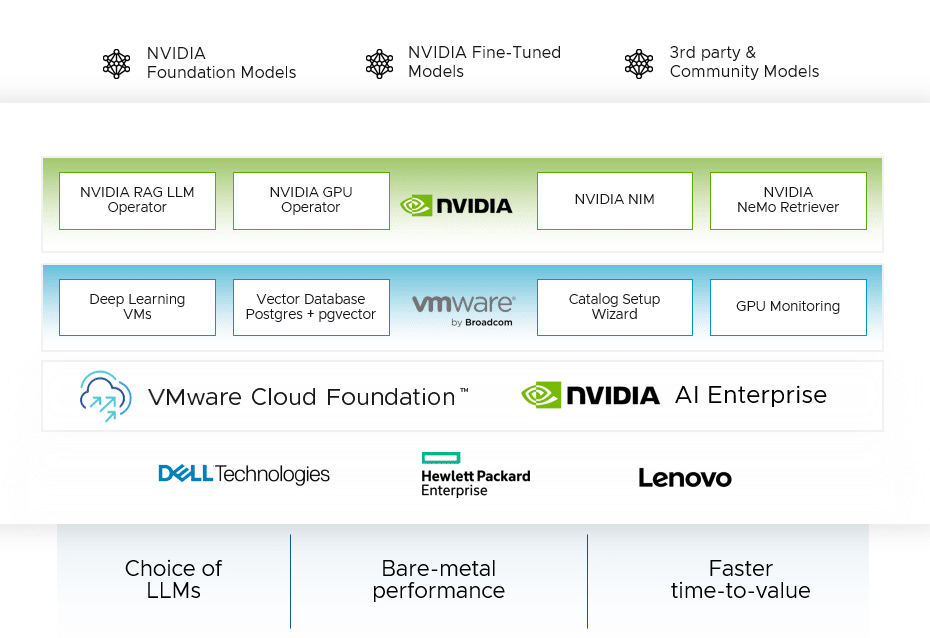

VMware Private AI Foundation con NVIDIA è progettata per promuovere l'implementazione di flussi di lavoro di Retrieval Augmented Generation (RAG), personalizzazione di modelli LLM e carichi di lavoro di inferenza all'interno dei data center. Offre soluzioni a problemi di privacy, costi e conformità tramite strumenti di automazione, immagini VM con deep learning, un database vettoriale e funzionalità di monitoraggio della GPU. In particolare, è essenziale acquisire licenze NVIDIA AI Enterprise separate per la piena funzionalità.

VMware Private AI Foundation con i vantaggi NVIDIA

Privacy, sicurezza e conformità: la piattaforma offre un'architettura sofisticata che garantisce la privacy dei dati, una rigorosa sicurezza e una rigorosa conformità. È sostenuto dall'infrastruttura cloud di VMware, che include funzionalità come Secure Boot e crittografia VM.

Prestazioni migliorate: sfruttando le innovazioni di Broadcom e NVIDIA, la piattaforma è progettata per massimizzare le prestazioni per i modelli di intelligenza artificiale generativa, con strumenti per un utilizzo efficiente della GPU e strutture di rete sofisticate come NVIDIA NVLink e NVSwitch.

Semplificazione dell'implementazione e ottimizzazione dei costi: la VMware Private AI Foundation con NVIDIA mira a semplificare l'implementazione e ridurre i costi associati ai modelli di intelligenza artificiale generativa, facilitati da una suite di gestione completa e da meccanismi di condivisione delle risorse.

Architettura

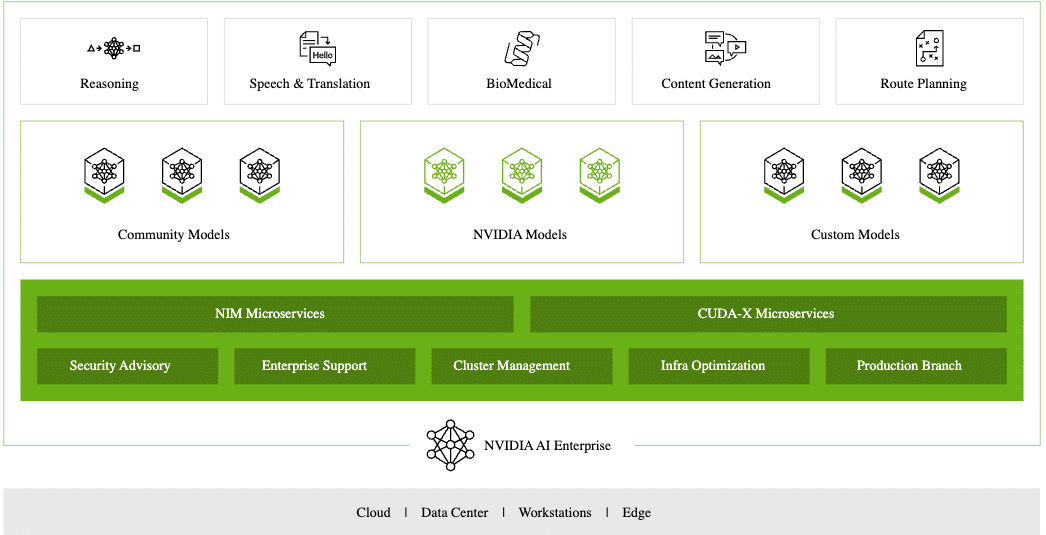

Fondamentalmente, VMware Cloud Foundation offre una soluzione completa per l'infrastruttura cloud, mentre NVIDIA AI Enterprise fornisce un'ampia piattaforma software AI nativa del cloud. Insieme, consentono alle organizzazioni di implementare in modo efficace modelli di IA sicuri e privati.

VMware Private AI Foundation con NVIDIA consente implementazioni on-premise che forniscono alle aziende i controlli per affrontare rapidamente molte sfide di conformità normativa senza sottoporsi a una significativa riarchitettura dell'ambiente esistente.

La configurazione manuale di una VM con deep learning può essere un processo complesso e dispendioso in termini di tempo. Questo approccio manuale può portare a incoerenze tra diversi ambienti di sviluppo, influenzando l'ottimizzazione. Per aiutare i clienti, VMware Private AI Foundation con NVIDIA offre VM di deep learning preconfigurate con i framework software necessari come NVIDIA NGC, librerie e driver. Ciò evita agli utenti il fastidio di configurare ciascun componente individualmente.

VMware ha abilitato i database vettoriali sfruttando pgvector su PostgreSQL. Questa funzionalità viene gestita tramite l'automazione nativa dell'infrastruttura e la gestione dei servizi dati in VMware Cloud Foundation. Data Services Manager semplifica l'implementazione e la gestione di database commerciali e open source da un unico pannello di controllo. I database vettoriali sono essenziali per i flussi di lavoro RAG per consentire query rapide sui dati e miglioramenti dell'output LLM in tempo reale senza riqualificazione.

VMware Cloud Foundation ha introdotto una procedura guidata di configurazione del catalogo all'interno del portale self-service per semplificare il provisioning dell'infrastruttura per i progetti IA. Ciò riduce i carichi di lavoro manuali e accelera l'accesso all'infrastruttura AI/ML.

VMware Private Foundation e NVIDIA introducono funzionalità di monitoraggio della GPU in VMware Cloud Foundation. Queste funzionalità forniscono visualizzazioni dell'utilizzo delle risorse GPU tra cluster e host insieme alla memoria host esistente e alle console di capacità, approfondimenti sui parametri delle prestazioni della GPU e aiutano nell'ottimizzazione e nella gestione dei costi.

Funzionalità aziendali di intelligenza artificiale NVIDIA

Le funzionalità NVIDIA AI Enterprise includono:

- NVIDIA NIM: una suite di microservizi che accelera l'implementazione dell'intelligenza artificiale di generazione in un'ampia gamma di modelli IA, utilizzando il software NVIDIA fondamentale per un'inferenza efficiente.

- NVIDIA NeMo Retriever: questo componente della piattaforma NVIDIA NeMo offre microservizi per connettere modelli personalizzati ai dati aziendali, garantendo risposte ad alta precisione con una privacy ottimale dei dati.

- Operatore NVIDIA RAG LLM: semplificazione dell'implementazione delle applicazioni RAG negli ambienti di produzione utilizzando esempi di flusso di lavoro AI di NVIDIA.

- Operatore GPU NVIDIA: automatizza la gestione del software necessario per l'utilizzo delle GPU all'interno di Kubernetes, migliorando le prestazioni e l'efficienza di gestione.

- Supporto OEM di server: la piattaforma è supportata da importanti OEM di server come Dell, HPE e Lenovo, garantendo ampia compatibilità e supporto.

La VMware Private AI Foundation con NVIDIA è una potente soluzione su misura per consentire alle aziende di implementare e gestire modelli di intelligenza artificiale. Comprende un ecosistema che affronta la sicurezza, le prestazioni e la sostenibilità dei progetti di intelligenza artificiale. Utilizzando VM di deep learning, database vettoriali e una serie di strumenti NVIDIA, la piattaforma semplifica l'implementazione e la gestione dei modelli IA soddisfacendo al tempo stesso i requisiti aziendali in termini di conformità e prestazioni. I principali OEM di server sostengono la piattaforma, garantendo un approccio olistico e cooperativo all'intelligenza artificiale.

Interagisci con StorageReview

Newsletter | YouTube | Podcast iTunes/Spotify | Instagram | Twitter | TikTok | RSS feed