2023년 VMware Explore 이벤트에서 VMware는 NVIDIA와 협력하여 VMware Private AI 및 VMware Private AI Foundation을 발표했습니다. 이번 주 NVIDIA GTC에서 VMware는 NVIDIA와 함께 VMware Private AI Foundation의 최초 출시를 발표함으로써 한 걸음 더 다가섰습니다.

2023년 VMware Explore 이벤트에서 VMware는 NVIDIA와 협력하여 VMware Private AI 및 VMware Private AI Foundation을 발표했습니다. 이번 주 NVIDIA GTC에서 VMware는 NVIDIA와 함께 VMware Private AI Foundation의 최초 출시를 발표함으로써 한 걸음 더 다가섰습니다. 이러한 협력을 통해 NVIDIA의 AI 추론 마이크로서비스를 통합한 VMware Cloud Foundation 기반 플랫폼이 개발되었습니다. 이 플랫폼에는 Hugging Face와 같은 회사의 기여도 포함됩니다.

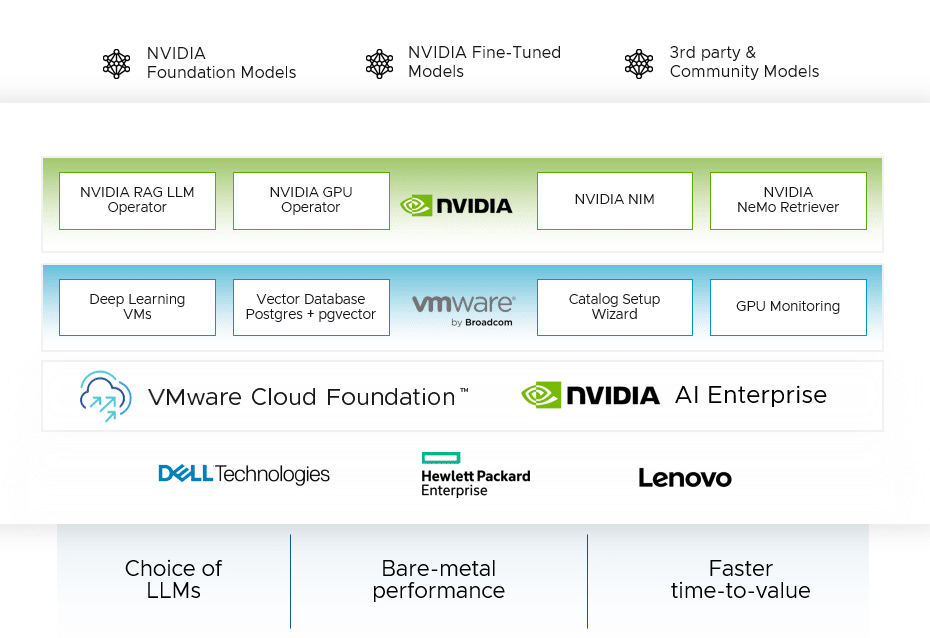

NVIDIA가 포함된 VMware Private AI Foundation은 데이터 센터 내에서 RAG(Retrieval Augmented Generation) 워크플로, LLM 모델 사용자 지정 및 추론 워크로드의 구현을 향상하도록 설계되었습니다. 자동화 도구, 딥 러닝 VM 이미지, 벡터 데이터베이스 및 GPU 모니터링 기능을 통해 개인 정보 보호, 비용 및 규정 준수 문제에 대한 솔루션을 제공합니다. 특히, 전체 기능을 이용하려면 별도의 NVIDIA AI Enterprise 라이선스를 취득하는 것이 필수적입니다.

NVIDIA의 장점을 활용한 VMware 프라이빗 AI 기반

개인 정보 보호, 보안 및 규정 준수: 이 플랫폼은 데이터 개인 정보 보호, 엄격한 보안 및 엄격한 규정 준수를 보장하는 정교한 아키텍처를 제공합니다. 보안 부팅 및 VM 암호화와 같은 기능을 포함하는 VMware의 클라우드 인프라가 이를 뒷받침합니다.

향상된 성능: Broadcom과 NVIDIA의 혁신을 활용하여 플랫폼은 효율적인 GPU 활용을 위한 도구와 NVIDIA NVLink 및 NVSwitch와 같은 정교한 네트워크 패브릭을 갖춘 생성 AI 모델의 성능을 극대화하도록 설계되었습니다.

배포 단순화 및 비용 최적화: NVIDIA와 함께하는 VMware Private AI Foundation은 포괄적인 관리 제품군과 리소스 공유 메커니즘을 통해 배포를 간소화하고 생성적 AI 모델과 관련된 비용을 줄이는 것을 목표로 합니다.

아키텍처

핵심적으로 VMware Cloud Foundation은 포괄적인 클라우드 인프라 솔루션을 제공하는 반면, NVIDIA AI Enterprise는 광범위한 클라우드 네이티브 AI 소프트웨어 플랫폼을 제공합니다. 이를 통해 조직은 안전한 비공개 AI 모델을 효과적으로 배포할 수 있습니다.

NVIDIA가 포함된 VMware Private AI Foundation을 사용하면 기업에 기존 환경을 대대적으로 재구성하지 않고도 많은 규정 준수 문제를 신속하게 해결할 수 있는 제어 기능을 제공하는 온프레미스 배포가 가능합니다.

딥 러닝 VM을 수동으로 설정하는 것은 시간이 많이 걸리고 복잡한 프로세스일 수 있습니다. 이러한 수동 접근 방식은 다양한 개발 환경에서 불일치를 발생시켜 최적화에 영향을 미칠 수 있습니다. 고객을 지원하기 위해 NVIDIA 기반 VMware Private AI Foundation은 NVIDIA NGC, 라이브러리 및 드라이버와 같은 필수 소프트웨어 프레임워크가 포함된 사전 구성된 딥 러닝 VM을 제공합니다. 이를 통해 사용자는 각 구성 요소를 개별적으로 설정해야 하는 번거로움을 덜 수 있습니다.

VMware는 PostgreSQL에서 pgVector를 활용하여 벡터 데이터베이스를 활성화했습니다. 이 기능은 VMware Cloud Foundation의 기본 인프라 자동화 및 데이터 서비스 관리를 통해 관리됩니다. Data Services Manager는 단일 창에서 오픈 소스 및 상용 데이터베이스의 배포 및 관리를 단순화합니다. 벡터 데이터베이스는 재교육 없이 신속한 데이터 쿼리와 실시간 LLM 출력 향상을 가능하게 하는 RAG 워크플로에 필수적입니다.

VMware Cloud Foundation은 AI 프로젝트를 위한 인프라 프로비저닝을 간소화하기 위해 셀프 서비스 포털 내에 카탈로그 설정 마법사를 도입했습니다. 이를 통해 수동 워크로드가 줄어들고 AI/ML 인프라에 대한 액세스가 빨라집니다.

VMware Private Foundation과 NVIDIA는 VMware Cloud Foundation에 GPU 모니터링 기능을 도입했습니다. 이러한 기능은 기존 호스트 메모리 및 용량 콘솔과 함께 클러스터 및 호스트 전체의 GPU 리소스 활용도에 대한 보기, GPU 성능 지표에 대한 통찰력, 최적화 및 비용 관리 지원을 제공합니다.

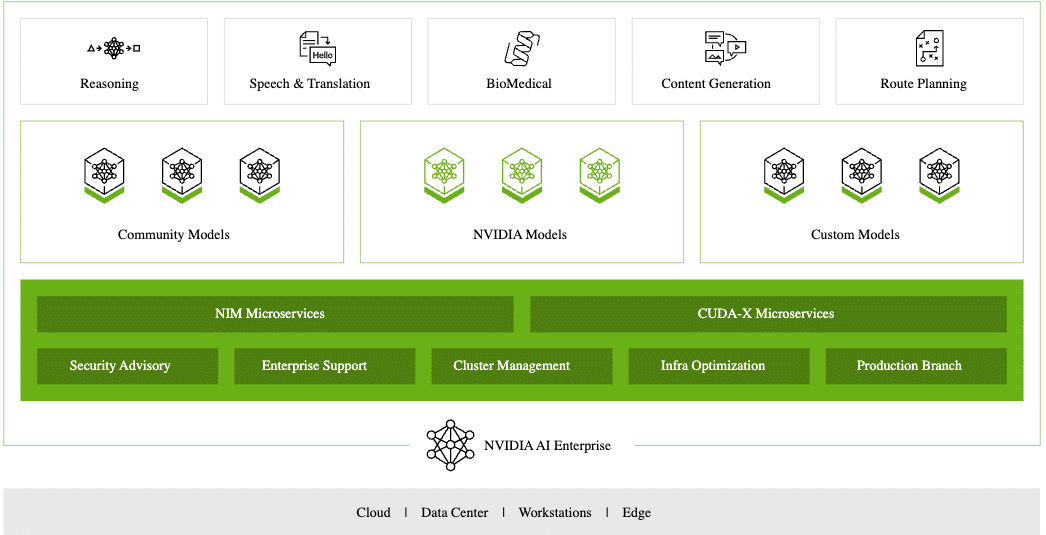

NVIDIA AI 엔터프라이즈 기능

NVIDIA AI Enterprise 기능은 다음과 같습니다.

- NVIDIA NIM: 효율적인 추론을 위해 기본 NVIDIA 소프트웨어를 활용하여 다양한 AI 모델 전반에 걸쳐 Gen AI 배포를 가속화하는 마이크로서비스 제품군입니다.

- NVIDIA NeMo 리트리버: NVIDIA NeMo 플랫폼의 이 구성 요소는 맞춤형 모델을 비즈니스 데이터에 연결하기 위한 마이크로서비스를 제공하여 최적의 데이터 개인 정보 보호로 높은 정확도의 응답을 보장합니다.

- NVIDIA RAG LLM 운영자: NVIDIA의 AI 워크플로우 예제를 활용하여 RAG 애플리케이션을 프로덕션 환경에 효율적으로 배포합니다.

- NVIDIA GPU Operator: Kubernetes 내에서 GPU를 활용하는 데 필요한 소프트웨어 관리를 자동화하여 성능과 관리 효율성을 향상합니다.

- 서버 OEM 지원: 이 플랫폼은 Dell, HPE, Lenovo와 같은 주요 서버 OEM의 지원을 받아 광범위한 호환성과 지원을 보장합니다.

NVIDIA가 포함된 VMware Private AI Foundation은 기업이 AI 모델을 배포하고 관리할 수 있도록 지원하는 강력한 솔루션입니다. 이는 AI 프로젝트의 보안, 성능 및 지속 가능성을 다루는 생태계를 포함합니다. 딥 러닝 VM, 벡터 데이터베이스 및 NVIDIA 도구 세트를 사용하여 플랫폼은 규정 준수 및 성능에 대한 기업 요구 사항을 충족하는 동시에 AI 모델의 배포 및 관리를 간소화합니다. 선도적인 서버 OEM은 AI에 대한 전체적이고 협력적인 접근 방식을 보장하는 플랫폼을 지지합니다.

StorageReview에 참여

뉴스레터 | 유튜브 | 팟캐스트 iTunes/스포티 파이 | 인스타그램 | 트위터 | 틱톡 서비스 | RSS 피드