生成式 AI 应用程序会创建令人印象深刻的文本响应,这些响应有时是准确的,有时则完全偏离主题。 这些智能应用程序由大型语言模型 (LLM) 提供支持,能够回答复杂的查询并创作艺术作品、文学作品等。 确保这些智能应用程序生成准确、适当、切合主题、安全且最新的文本响应至关重要。

生成式 AI 应用程序会创建令人印象深刻的文本响应,这些响应有时是准确的,有时则完全偏离主题。 这些智能应用程序由大型语言模型 (LLM) 提供支持,能够回答复杂的查询并创作艺术作品、文学作品等。 确保这些智能应用程序生成准确、适当、切合主题、安全且最新的文本响应至关重要。

NVIDIA 发布了开源软件,以帮助开发人员保持这些生成式 AI 应用程序正常运行。 NeMo Guardrails 将有助于确保 AI 应用程序做出适当、准确和安全的响应。 NeMo Guardrails 软件包含企业需要的所有代码、示例和文档,可让企业对部署生成文本的 AI 应用充满信心。

企业影响

由于担心安全、安保以及 LLM 可能生成不适当或有偏见的内容,企业对实施大型语言模型 (LLM) 表现出犹豫。 NeMo Guardrails 的推出为这些挑战提供了一个有前途的解决方案,有助于降低与 LLM 采用相关的风险,并帮助企业克服犹豫。 通过提供用于构建安全且值得信赖的 LLM 对话系统的工具包,NeMo Guardrails 允许开发人员轻松建立可编程规则来指示用户交互,确保基于 LLM 的应用程序遵守企业标准和策略。

NeMo Guardrails 支持的主题、安全和安全护栏解决了我们从企业那里听到的一些主要问题,从保持主题焦点到防止错误信息或不适当或恶意的响应。 通过提供强大的安全模型并降低与基于 LLM 的应用程序相关的风险,NeMo Guardrails 增强了企业采用这一强大技术的信心。

随着 NeMo Guardrails 的发布,希望它可以成为更广泛的企业采用 LLM 的催化剂,弥合人工智能技术的能力与商业世界的安全和保障要求之间的差距。

安全,切合主题,安全

许多行业在推出 AI 应用程序时都采用 LLM,这些应用程序最终将回答客户问题、为冗长的文档提供摘要、编写软件并加速药物设计。 对于这种多样化的受众,生成式 AI 的安全性是一个重要问题,NVIDIA NeMo Guardrails 旨在与所有 LLM 合作,包括 OpenAI 的 ChatGPT,以帮助确保用户安全。

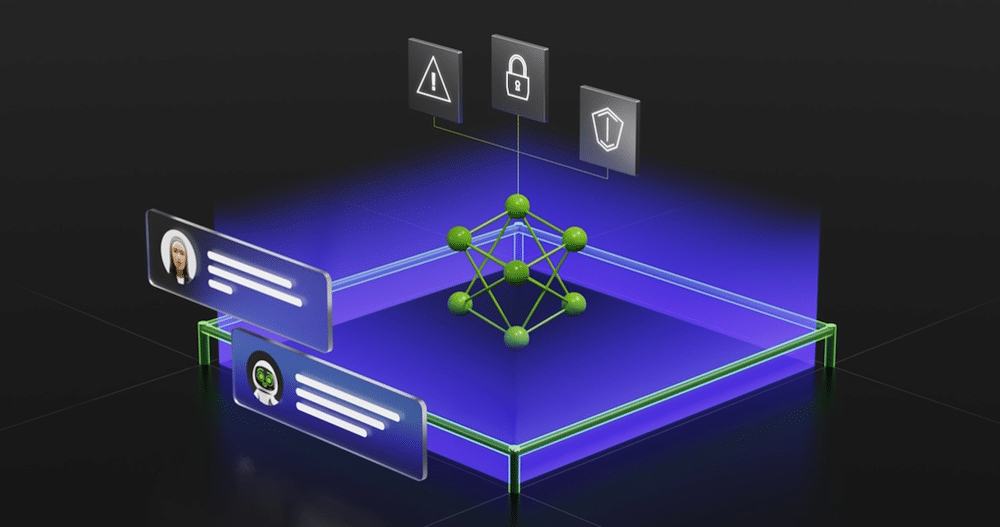

开发者可以使用 NeMo Guardrails 设置三种边界:

- 局部护栏: 防止应用程序偏离路线进入某些不需要的区域,例如阻止客户服务助理回答有关天气的问题。

- 安全护栏: 确保应用程序以准确、适当的信息响应,过滤掉不需要的语言并强制仅对可靠来源进行引用。

- 安全护栏:限制应用程序仅与已知安全的外部第三方应用程序建立连接。

NeMo Guardrails 不要求软件开发人员成为机器学习专家或成为数据科学家。 只需几行代码即可快速创建新规则。

开源并在 GitHub 上可用

NVIDIA 正在将 NeMo Guardrails 添加到 NVIDIA NeMo 框架中,为用户提供训练和调整语言模型所需的一切。 GitHub 上已经提供了大部分 NeMo 框架,企业可以获得完整且受支持的软件包,因为它是 NVIDIA AI Enterprise 软件平台的一部分。

NeMo 也是 NVIDIA AI Foundations 的一部分,这是一个云服务系列,适用于希望根据自己的数据集和领域知识创建和运行自定义生成 AI 模型的企业。

建立在 Colang 上

NeMo Guardrails 基于 CoLang 构建,CoLang 是一种建模语言和用于对话式 AI 的相关运行时。 Colang 为用户提供了一个可读和可扩展的界面来定义或控制使用自然语言的对话机器人的行为。

护栏是通过使用规范形式、消息和流在 Colang 文件中定义流来创建的。 这是使用自然语言实现的,使其易于构建并使机器人继续执行任务。 一些 GitHub 示例 解决实施护栏的常见模式。

参与 StorageReview

电子报 | YouTube | 播客 iTunes/Spotify | Instagram | Twitter | TikTok | RSS订阅